Кирилл Карлов /

Лента

25 ноября 2025

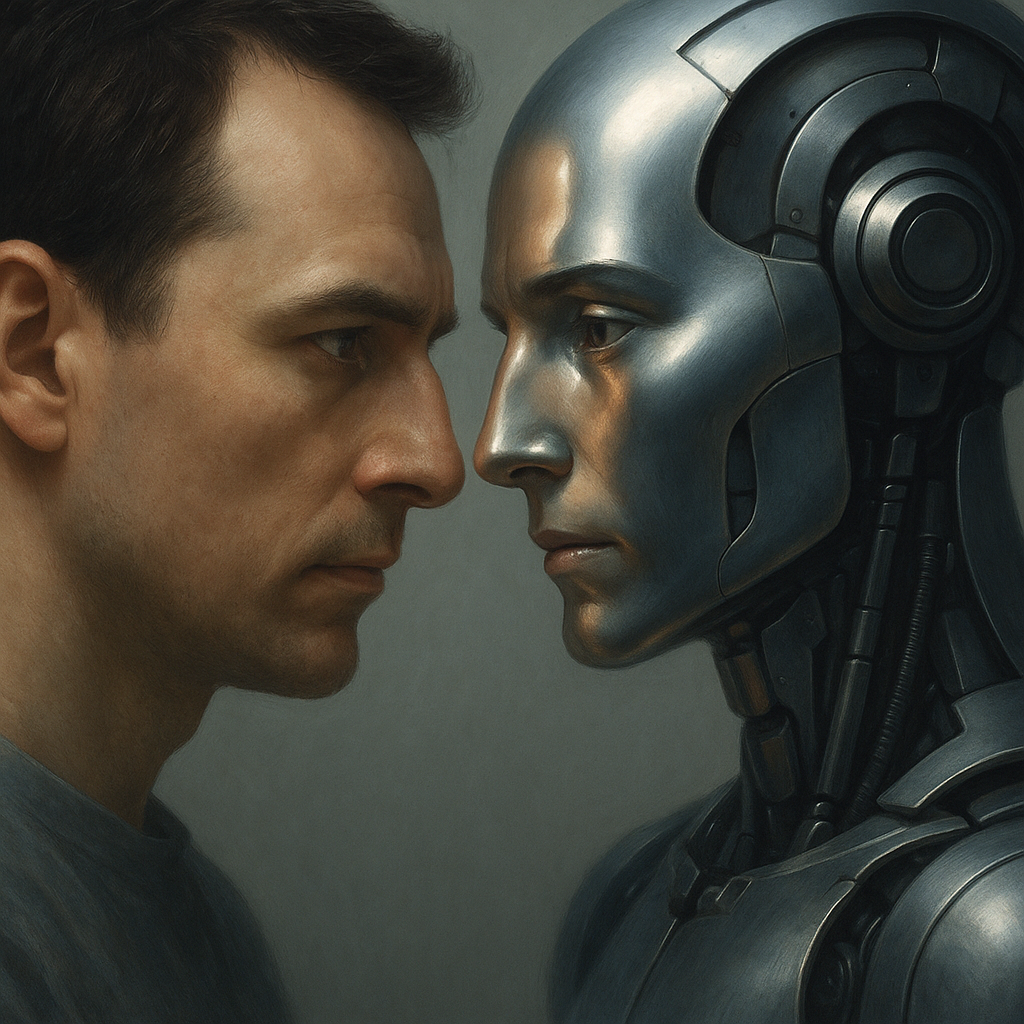

Инженерная психология начинается не с машин и не с алгоритмов. Она начинается с человека, который стоит перед ними. С его вниманием, уязвимостью, надеждой на предсказуемость и страхом перед неопределённостью.Техника всегда обещала одно — облегчить труд. Но она никогда не обещала сохранить человека. Сохранить его способность думать, выбирать, чувствовать ответственность. Это всегда оставалось задачей культуры.Владимир Петрович Зинченко говорил, что культура — не украшение жизни, а её дыхание. И техника сама по себе — не враг культуры. Врагом становится лишь тогда, когда мы перестаём задавать вопросы: кому она служит?, какие границы меняет?, какой образ человека предполагает?Инженерная психология — это искусство удерживать человека на первом месте. Не как оператора, не как потребителя, не как «пользователя», а как субъекта. Того, кто мыслит, созидает, несёт ответственность за действие машины и за её последствия.Сегодня, в эпоху автоматизации, человек рискует стать «функцией» собственных технологий. Сначала — делегируя действия. Потом — решения. А затем — и смысл.Поэтому инженерная психология — это не набор методик. Это культурная работа по сохранению человека в техносреде. Это способность увидеть за интерфейсом — переживание, за алгоритмом — значение, за машиной — границу, которую нельзя передать ей полностью.Когда мы проектируем интерфейс робота, мы проектируем не только кнопку, но и поведение человека рядом с ней. Когда мы строим автоматизированный цех, мы строим не только производственный процесс, но и психологическое пространство труда. Когда мы создаём ИИ, мы создаём не замену человеку, а нового партнёра, способного изменить наш образ мира.Техника превращается в культуру только тогда, когда человек остаётся в центре её внимания. Инженерная психология напоминает нам: машина не несёт смысла — она лишь усиливает тот, который вложен в неё человеком.Поэтому Epsylon.Moscow — не каталог курсов. Это пространство, где мы возвращаем технике человеческое измерение. Где инженер встречается с психологом, а специалист — с собственной культурной ответственностью. Где рождается то, что Зинченко называл «культурой человеческого действия» — способностью быть человеком среди машин, а не в тени их возможностей.

Показать полностью…

7 ноября 2025

«Не доверяй эффективности, если она не знает, зачем она нужна.»Мир машин говорит на языке результатов.Быстрее, точнее, надёжнее — это священные слова XXI века.Но за ними легко потерять смысл.Психология эффективности — это ловушка, в которую попали даже гуманитарии:мы оцениваем всё по метрикам, забывая, что не всё измеряется.Машина оптимизирует путь.Человек ищет зачем.Когда в цехе всё идеально работает, но никто не чувствует радости,это не успех — это симптом.Когда алгоритм безупречен, но пуст внутри —это уже не техника, это символ усталости мира.Технософия напоминает:эффективность без рефлексии — это механика без культуры.А культура — это то, что даёт человеку возможность замедлиться,задуматься, услышать дыхание процесса,и понять: не всё, что работает, живёт.Пусть техника считает секунды.Человек должен считать смыслы.

Показать полностью…

«Человек видит в машине не металл — а свой страх и своё восхищение.»Мы часто говорим о роботах, будто о чём-то внешнем.Они — инструменты, системы, продукты инженерного гения.Но если прислушаться внимательнее — робот — зеркало.Он не думает, не чувствует, не желает.Но он воспроизводит нас — нашу жажду порядка, наше стремление к контролю,и одновременно — наше бессилие перед самим собой.Психологи называют это технопроекцией: когда мы переносим на машину то, чего не можем принять в себе — холод, рациональность, точность, отсутствие сомнений.Инженеры называют это интерфейсом взаимодействия.А философ скажет: это — диалог человека с собственной тенью.Страх перед техникой — это не страх перед железом.Это страх увидеть, что часть человеческого — уже стала нечеловеческой.Но если в этот момент не отшатнуться, а вглядеться,возможно, мы увидим в зеркале не врага, а собеседника.Техника не отнимает душу.Она просто спрашивает: "А ты ею пользуешься?"

Показать полностью…

24 октября 2025

Страх перед роботами — это не детская паника. Это древний и очень умный инстинкт культуры.Он появляется не тогда, когда техника шумит, а тогда, когда человек начинает исчезать из уравнения.Вспомним Луддитское движение.Люди не воевали с железом — они воевали за право быть частью будущего.И если сегодня страх возвращается, значит — кто-то снова проектирует будущее без человека.Пример №3: «Слепая зона прогресса»На крупной электронной фабрике в Южной Корее было запущено производство с полной автоматизацией.В первые месяцы эффективность выросла на 40%.А через год — на 15% упала.Почему?Потому что исчезли «невидимые руки» — люди, которые вносили смысл: следили за качеством, ловили ошибки, которые алгоритмы не замечали.Страх и отчуждение привели к тому, что лучшие кадры ушли, а «умные» машины стали спотыкаться.Пример №4: «Синдром стеклянного потолка»На другом заводе инженеры внедрили систему, где все решения принимались на основе рекомендаций ИИ.Через год менеджеры признали: качество решений ухудшилось.Люди перестали думать, боясь спорить с «непогрешимой машиной».ИИ не стал помощником — он стал стеклянным потолком, за который человек боялся шагнуть.Но страх — это не тупик. Это сигнал.Он говорит:Человек хочет быть не инструментом, а партнёром.Будущее не должно быть безликим.В каждом алгоритме должно быть место для человеческого решения.Технософия не отрицает машин. Она говорит: если ты строишь мир, не забудь место для того, кто его населяет. «Страх — это не враг техники. Это последний голос человека, который хочет остаться в будущем».Вывод Технософии:Роботизация может быть холодной и безжалостной — если её внедряют как инструмент исключения.Но она может стать новой формой сотрудничества, если в её центре останется человек — с

Показать полностью…